KI im Unternehmen – Herausforderungen an die betriebliche Gestaltung moderner Arbeit

Eine Befragung von Beschäftigten zu ihrer Einstellung gegenüber der Nutzung von KI bei der Arbeit ergab – entgegen immer wieder behaupteter Angstzuschreibung – ein abgewogenes „Es kommt darauf an“. Wichtig ist es, Beschäftigte von Anfang an bei der Installation von KI im Betrieb zu beteiligen.

Die Folgen von künstlicher Intelligenz (KI) für die Arbeit werden schon seit Jahren diskutiert, haben aber mit ChatGPT und anderen generativen KI-Systemen oder Large Language Models (LLM) neue Aufmerksamkeit erfahren. Noch finden sich vor allem Prognosen zum Automatisierungspotenzial. So kommt eine aktuelle Studie[1] für die USA zu der Einschätzung, dass mehr Beschäftigte in nicht von KI betroffenen Berufen tätig sind als in Berufen, die am meisten von KI betroffen sind. Zudem seien Jüngere und formal geringer Qualifizierte am wenigsten von KI betroffen. Eine der ersten Studien zur Nutzung generativer KI in Deutschland zeigt, dass diese am häufigsten bei der selbstständigen Textverarbeitung und -erstellung eingesetzt wird.[2]

(Nicht nur) in Bezug auf KI ist die viel beschworene Angst davor wohl eher ein medial und von Unternehmensberatungen entfesseltes Phänomen, „emotional aufgeladene diskursive Erwartungen“ jedoch helfen in der KI-Debatte nicht weiter.[3] KI ist die aktuell am stärksten diskutierte Variante der Digitalisierung. Während sie medial lange vor allem als Auslöser sogenannter „technologischer Arbeitslosigkeit“ galt, wird sie aktuell angesichts des Fachkräftemangels auch als Hoffnungsschimmer gesehen.

So oder so geht man dabei immer davon aus, dass KI vor allem das Potenzial hat, menschliche Arbeit zu ersetzen. Diese Frage nach dem Automatisierungspotenzial der KI ist wohl so alt wie die Idee der KI selbst. Das Problem damit zusammenhängender Prognosen ist vor allem eines: Sie beschränken sich auf den Arbeitsmarkt, unterschätzen die Grenze der Formalisierbarkeit humaner Arbeit[4] und verweisen das Thema gleichzeitig in die Zukunft. Viel zu wenig Beachtung finden Fragen nach der Einstellung der Beschäftigten zu KI sowie zu den konkreten Gestaltungsanforderungen, die sich bei der Nutzung von KI im Hier und Jetzt an die Unternehmen stellen.

Bisher sind Studien zur Einstellung von Beschäftigten gegenüber KI dünn gesät, beziehen sich nur auf einen Anwendungskontext oder fassen KI und Robotik unterschiedslos zusammen. Zudem erlauben die in anderen Ländern erhobenen Ergebnisse wegen unterschiedlicher Arbeitsmarktstrukturen und Mitbestimmungskulturen keine einfache Übertragung auf Deutschland. Studien aus Deutschland wie der Meinungsmonitor Künstliche Intelligenz[5] oder der aktuelle D21-Digital Index[6] beziehen sich nur in wenigen Punkten auf die Arbeitswelt und/oder nur sehr allgemein auf KI und sie nehmen kaum die Effekte des KI-Einsatzes auf die Arbeitsqualität in den Fokus.[7]

Daher zunächst ein Blick auf die Einstellung von Beschäftigten zu KI aus der Studie „KIK – KI als Kollegin?“ (zur Erhebung: siehe Infokasten).

Studie „KIK – KI als Kollegin?“[8]

Basis der vorgestellten Daten ist eine 2022 an der Friedrich-Alexander-Universität (FAU) Erlangen-Nürnberg durchgeführte Onlinestudie. Über aktives Quoten-Management und iterative Gewichtung konnte ein nach Geschlecht, Alter, Qualifikationshöhe und Branche den aktuellen Arbeitsmarktdaten repräsentatives Sample von n = 2.018 gebildet werden. Die Studie wurde durchgeführt im Rahmen des Forschungsverbunds „KI – Mensch – Gesellschaft“ vom Bundesministerium für Bildung und Forschung (BMBF).

Zögerlich-ungleichzeitiges Ankommen: KI am Arbeitsplatz

Gefragt nach der KI-Nutzungshäufigkeit gibt 2019 ein Viertel der Beschäftigten in Deutschland mindestens eine seltene Nutzung an. Die Zahl erscheint für eine Erhebung vor einigen Jahren überraschend hoch, die Nutzungshäufigkeit adressiert nur die Variante, am Arbeitsplatz etwas mit KI zu tun zu haben. Jenseits dieser reinen Nutzung, bei der KI Arbeitsmittel ist, kann KI auch Arbeitsgegenstand sein, zum Beispiel weil der Change-Prozess dazu organisiert wird oder weil KI nur Teil einer komplexeren Produktentwicklung ist. Obwohl drei Jahre später eine breitere Abfrage nach dem Einsatz von KI am Arbeitsplatz erfolgte, zeigt sich in unserer Studie eine geringere Verbreitung.

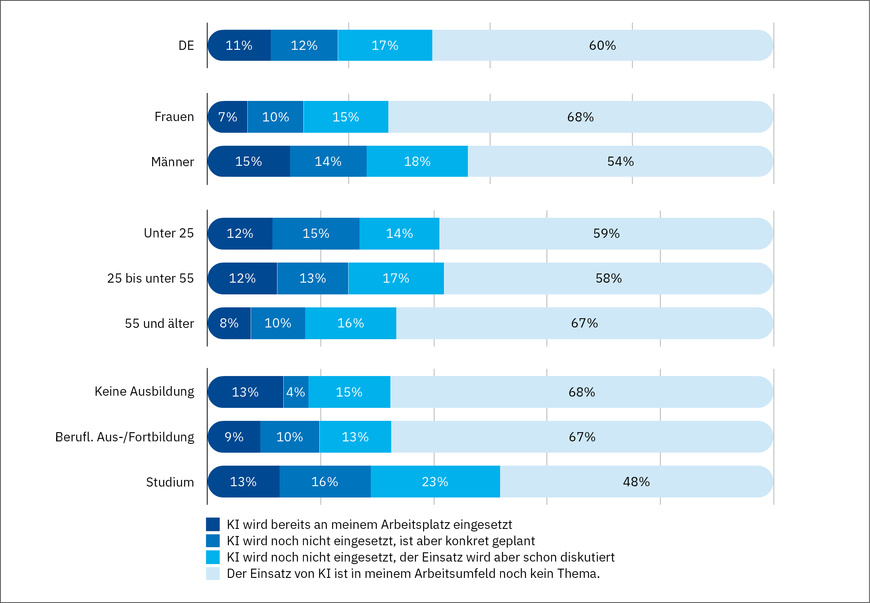

So gibt nur ein Teil von elf Prozent der Befragten an, dass KI schon am Arbeitsplatz eingesetzt wird, bei weiteren zwölf Prozent sei ein Einsatz schon konkret geplant und in 17 Prozent der Fälle wird im Betrieb zumindest bereits darüber diskutiert (Abbildung 1). Trotzdem bleibt KI für die Mehrheit von 60 Prozent der Beschäftigten wohl auch in naher Zukunft noch ein unbekanntes Terrain am Arbeitsplatz. Die weiteren Balkengrafiken in Abbildung 1 zeigen, dass Frauen mit 68 Prozent gegenüber Männern mit 54 Prozent und über 55-Jährige mit 67 Prozent gegenüber Jüngeren häufiger noch keine (Aussicht auf) KI am Arbeitsplatz haben. Bei der Qualifikation zeigt sich eine interessante Polarisierung: Jeweils 13 Prozent der Beschäftigten ohne Abschluss und mit akademischem Abschluss haben schon KI am Arbeitsplatz, während es bei den beruflich Aus- und Fortgebildeten neun Prozent sind. Nimmt man jedoch den geplanten und diskutierten KI-Einsatz hinzu, findet sich bei den akademisch Qualifizierten mit 48 Prozent der kleinste Anteil derer, bei denen KI aktuell oder demnächst eine Rolle spielen dürfte.

Bedingte Skepsis, ausgewogene Risiko-/Nutzenabwägung

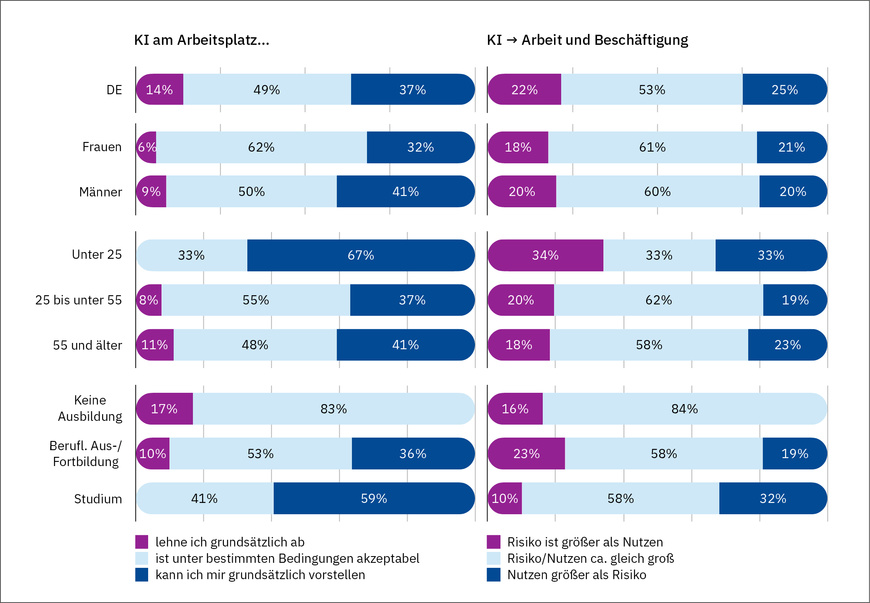

Abbildung 2 gibt einen ersten Eindruck zur Einstellung von Beschäftigten gegenüber KI. Entgegen der immer wieder zu hörenden Angstzuschreibung zeigt sich ein recht eindeutiges „Es kommt darauf an“. Auf der linken Seite finden sich die Ergebnisse zum Einsatz von KI am Arbeitsplatz: Der kleinste Anteil von 14 Prozent der Befragten lehnt dies grundsätzlich ab, 37 Prozent dagegen können sich das grundsätzlich vorstellen.

Frauen zeigen mit sechs Prozent eine geringere grundsätzliche Ablehnung als Männer mit neun Prozent. Letztere wiederum können sich mit 41 Prozent den KI-Einsatz am Arbeitsplatz deutlich häufiger vorstellen als der Anteil von 32 Prozent bei den Frauen. Die deutlichste Ablehnung findet sich bei Beschäftigten ohne qualifizierten Abschluss: 17 Prozent von ihnen lehnen KI-Einsatz bei der Arbeit grundsätzlich ab und niemand aus dieser Gruppe spricht sich für deren grundsätzlichen Einsatz aus. Außer bei unter 25-Jährigen und akademisch Qualifizierten überwiegt in allen Gruppen statt einer grundsätzlichen Pro- oder Kontrahaltung die mittlere Antwortkategorie, nämlich dass ein Einsatz von KI nur unter bestimmten Bedingungen akzeptabel ist.

Wie komplex bis widersprüchlich die Meinung zu KI als Kollegin ist, zeigen die Ergebnisse der Balkengrafiken auf der rechten Seite von Abbildung 2: So erreichen die – wie erläutert – grundsätzlich besonders KI-offenen unter 25-Jährigen gleichzeitig mit 34 Prozent den höchsten Wert bei ihrer Einschätzung, in Bezug auf Arbeit und Beschäftigung überwiege das Risiko den Nutzen. Sie sind auch die polarisierteste Gruppe, denn mit 33 Prozent findet sich hier der geringste Anteil bei der Einschätzung, Risiko und Nutzen hielten sich die Waage. Insgesamt verbinden 22 Prozent der Beschäftigten mit KI ein erhöhtes Risiko im Hinblick auf Arbeit und Beschäftigung, 25 Prozent sehen einen größeren Nutzen und wiederum die Mehrheit von 53 Prozent hält Risiko und Nutzen für ausgewogen.

Ins Auge fällt auch, dass sich bei dieser allgemeinen, auf die Arbeit bezogenen Fragestellung kaum geschlechtsspezifische Unterschiede finden. Bei der stärker auf den eigenen Arbeitsplatz bezogenen Frage auf der linken Seite von Abbildung 2 zeigen sich diese Unterschiede viel stärker. Alle Zahlen in Abbildung 2 zeigen vor allem eines: Angst vor KI ist alles andere als ein vorherrschendes Gefühl der Beschäftigten – Skepsis aber findet sich durchaus, wenn auch nicht in hohen Anteilen.

Gestaltungsbereitschaft und Wunsch nach mehr Mitbestimmung

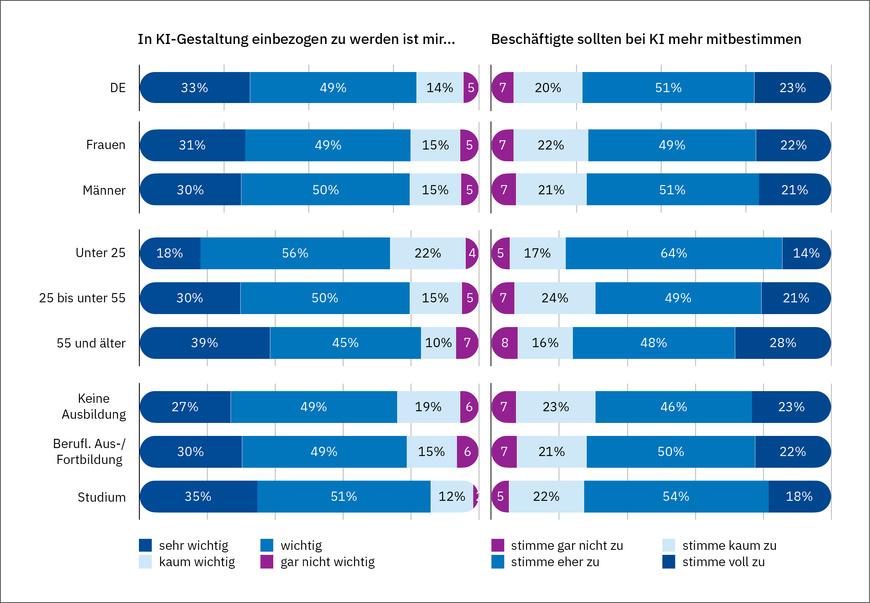

Die Zahlen in Abbildung 2 verweisen bereits auf einen klaren Gestaltungsbedarf und -auftrag, sind doch überwiegend die je mittleren Antwortkategorien am stärksten ausgeprägt. Deswegen finden sich in Abbildung 3 auch Zahlen zu zwei Fragen der Studie, die sich auf die Gestaltung beziehen: links die Frage nach der Wichtigkeit, selbst aktiv in den Gestaltungsprozess von KI einbezogen zu werden, rechts die Frage zur Bedeutung der Mitbestimmung beim Thema KI. Schon auf den ersten Blick zeigen die durchweg einstelligen, violett gekennzeichneten Anteile, dass nur sehr wenig Beschäftigte der Mitgestaltung und Mitbestimmung in Sachen KI keine Bedeutung beimessen. Hier fällt vor allem auf, dass die unter 25-Jährigen Mitgestaltung und Mitbestimmung am wenigsten wertschätzen, sie erreichen jeweils im Vergleich zu allen anderen Gruppen die geringsten Werte. 18 Prozent der unter 25-Jährigen ist es sehr wichtig, bei der Gestaltung von KI am Arbeitsplatz einbezogen zu sein. 14 Prozent stimmen der Aussage voll zu, dass Beschäftigte beim Thema KI mehr Mitbestimmung benötigten. Diese Gruppe ist altersbedingt erst vergleichsweise kurz im Erwerbsleben – möglicherweise fehlt hier noch die Erfahrung von schlecht eingeführten oder wenig zur Arbeit passenden IT-Systemen.

Insgesamt lässt sich auf jeden Fall eine klare Tendenz ausmachen: Die überwiegende Mehrheit der Beschäftigten findet es (sehr) wichtig, bei der KI-Gestaltung einbezogen zu werden (82 Prozent), und stimmt der Aussage, Beschäftigte benötigten bei KI mehr Mitbestimmung, eher/voll zu (74 Prozent). Diese Gestaltungsoffenheit der Beschäftigten wird auch dringend gebraucht, wenn man sich die Herausforderungen beim KI-Einsatz im Unternehmen konkreter anschaut.

KI-spezifische Gestaltungsherausforderungen im Betrieb

KI-Systeme sind letztlich statistische Systeme, ihre vermeintliche Intelligenz ist nicht mehr als eine Prognose, basierend auf Daten der Vergangenheit und mit einer in der Praxis oft unbekannten Prognosewahrscheinlichkeit. Sie sind wunderbare Tools – aber nur, wenn wir ihre Grenzen kennen, verstehen und mit ihnen umgehen lernen. Andernfalls kann ihr Einsatz gerade im Unternehmen auch schnell destruktiven Charakter haben.[9] Eingegangen wird hier bewusst nicht auf die bereits stark diskutierten Dimensionen der Blackbox oder des Bias. Der Fokus liegt hier auf einigen wenig beachteten, aber beim Einsatz von KI im Unternehmen gestaltungsbedürftigen und zunächst grundsätzlichen KI-spezifischen Problemen:

- Mehr-als-Bias-Problem: Wenn die Daten eine weniger offensichtliche Verzerrung aufweisen, die sich aus der Leichtigkeit oder Erschwernis beim Sammeln der Daten faktisch ergibt und auf die bei unreflektiertem Einsatz dann nicht mit Gewichtung reagiert wird.

- Kanonen-auf-Spatzen-Problem: Dem Hype um das Thema blind folgend nutzen Unternehmen KI-Prozesse auch da, wo eine feste Vercodung oder eine relationale Datenbank sachlich sinnvollere Ergebnisse mit weniger Aufwand und mehr Robustheit über die Zeit generieren würden.

- Komplexitätsreduktionsproblem: Wenn die Potenz des Algorithmus über- und die Komplexität des Anwendungskontexts unterschätzt wird und/oder der Algorithmus (das statistische Modell) – also die Reduktion der realen Komplexität – mit ebenjener gleichgesetzt wird.

- Schlüsselloch-Problem: Wenn der KI ein zu kleiner oder eingeschränkter Ausschnitt der viel komplexeren Welt präsentiert wird, weil die Messstellen oder Datenpunkte schlecht gewählt sind – die „Schlüssellöcher“ zur Welt sozusagen an den falschen Stellen sitzen oder die falsche „Form“ haben (beispielsweise das falsche Skalenniveau).

- Badewannen-Problem: Wenn man glaubt, der Unterschied von Korrelation und Kausalität wäre bei KI und Big Data nicht mehr wichtig und man müsse bei einem vermeintlichen Zusammenhang auf aggregierter Datenebene nicht mehr nach Erklärungen realer Zusammenhänge auf der Mikroebene suchen (man müsse also nicht in die „Coleman’sche Badewanne“ steigen, um einen ökologischen Fehlschluss zu vermeiden). Dies wird bei KI sogar noch wichtiger wegen des Datenrauschen-Problems.

- Datenrauschen-Problem: KI kann in großen Data Lakes für uns bislang nicht sichtbare Zusammenhänge finden – das ist ihre Stärke und Schwäche zugleich. Je mehr unstrukturierte, zufällige und oft unsauber aufgearbeitete Daten es gibt, desto höher ist jedoch die Wahrscheinlichkeit, Zusammenhänge zu finden, die nur ein statisches Artefakt sein könnten. Idealerweise müsste man also noch öfter in die oben genannte „Badewanne“ steigen.

- Datenpfützen-Problem: Wenn im Unternehmen die erwarteten „Data Lakes“ gerade dies nicht sind, sondern nur „Datenpfützen“, mit denen aufgrund der zu kleinen Lernbasis keine ausreichend stabilen Ergebnisse der KI erreicht werden können. Eng einher geht damit das Skalierungsproblem.

- Skalierungsproblem: Ein Lernprozess, der die KI zu einer nur geringen Prognosewahrscheinlichkeit befähigt, ist mit wenig Daten schnell gemacht. Soll die KI aber eine Prognosewahrscheinlichkeit von 95 Prozent oder mehr erreichen, steigen Daten- und Kostenaufwand exponentiell an – und sprengen schnell das technisch Machbare, ökonomisch Sinnvolle und produzieren einen oft immensen ökologischen Footprint.

- Inverses n-Prozent-Problem: Während alte Expertensysteme nur einen sehr geringen Prozentsatz des Fach- und Erfahrungswissens der Beschäftigten hart gecodet abbildeten, bleiben bei der KI immer n-Prozent an Aussageunsicherheit. Prognosen bleiben Prognosen und sind nie zu 100 Prozent korrekte Aussagen. Dies wiederum führt zum Vigilanz-2.0-Problem.

- Vigilanz-2.0-Problem: Paradoxerweise führen KI-Systeme mit besonders hoher Prognosewahrscheinlichkeit zu einer Anforderung an die Arbeitsgestaltung, wie sie aus Leitwarten schon lange bekannt ist: Je seltener etwas „passiert“ (bei der KI: ein unerwartetes, seltsames Ergebnis), desto geringer die Vigilanz (Wachsamkeit) – man vertraut immer mehr. Was nicht sein darf wegen des Doppeltblind-Problems.

- Doppeltblind-Problem: Während bei fast jeder Technik, die im Unternehmen zum Einsatz kommt, eine Fehlfunktion meist sofort erkennbar ist, lässt sich auch bei der besten KI nie mit Sicherheit sagen, ob sie richtig oder falsch liegt. Ein plausibel erscheinendes Ergebnis kann im Einzelfall falsch sein, ein seltsam-unerwartetes Ergebnis jedoch korrekt.

In the long run: Gestaltungsprobleme über die Zeit

Nicht nur Mechanik verschleißt, auch die beste KI kann im Laufe der Zeit wieder schlechter werden. Vier KI-spezifische Verschleißdynamiken sind dabei im betrieblichen Einsatz besonders relevant. Sie können sich zudem überlagern und wechselseitig verstärken:

- Äußeres-KI-Verschleißproblem: Wenn die komplexe Welt, aus der die KI lernt, sich ändert – die vorhandenen Daten und Messstellen aber nicht immer in der Lage sind, dies wahrzunehmen (→ Schlüssellochproblem).

- Inneres-KI-Verschleißproblem: Weil ein Großteil der KI-Algorithmen im Laufe der Zeit in ihren Lernprozessen überwiegend „in die Mitte tendieren“, also zunehmend möglicherweise sachlich relevante Beobachtungen als statistische Ausreißer, sozusagen als irrelevant, aussortieren.

- Katze-beißt-sich-in-den-Schwanz-oder Inzest-Problem: Je mehr KI im Einsatz ist, desto weniger humangenerierter Inhalt geht noch in die Lernprozesse ein. Die KI lernt zunehmend von sich selbst und wird in ihrer Aussagefähigkeit inhaltlich enger und weniger aktuell.

- Lern-Freeze-Lern-Problem: Für viele KI-Anwendungen ist noch völlig unklar (und wird es auch noch eine Zeit lang bleiben), wie lange mit welchen Daten gelernt werden soll, ob dies nur anfänglich oder dauerhaft und immer wieder aufs Neue passieren soll sowie nach welchen Kriterien dabei wann und von wem im Unternehmen entschieden wird.

Alte und neue Gestaltungsantworten

Die gute Nachricht ist: Mit diesen Problemen kann umgegangen werden. Dafür muss man sich ihrer aber erst einmal bewusst sein und KI als das betrachten, was sie ist: ein tolles Tool mit stochastischen Eigenheiten. Oft gibt es für die genannten (und sicher nicht abschließenden) Probleme keine einfache technische, also KI- beziehungsweise lerndatenbezogene Antwort. Auch die viel beschworene Perspektive auf eine wie auch immer gestaltete Mensch-KI-Arbeitsteilung hilft hier allein wenig weiter. Man muss also nicht nur den Menschen als wichtigen Faktor im System belassen („Human in the Loop“), sondern auch und vor allem die organisationalen Prozesse („Organisation in the Loop“).[10]

Das beginnt schon bei der Implementierung von KI im Unternehmen: Allzu oft liegt diese allein in den Händen von Informatik und Data Science, Expertinnen und Experten des angezielten Anwendungskontexts werden zu spät oder gar nicht einbezogen – oder nur beim Annotieren beziehungsweise Alignment. Es braucht sie aber von Anfang an: Weil es nicht nur das Wissen um Skalenniveaus der Daten und um die Notwendigkeit ihrer Passfähigkeit zum gewählten Algorithmus braucht, sondern auch das Wissen um die Notwendigkeit der Passfähigkeit von beidem mit den sachlichen Gegebenheiten des Anwendungskontexts.

Beschäftigte haben nicht nur das nötige Fach- und Erfahrungswissen aus den Anwendungskontexten, sondern bringen oft auch statistische Kenntnisse sowie IT-Verständnis mit und können von Anfang an produktiver Teil eines KI-Teams sein. Fast 15 Prozent der Beschäftigten bringen solche KI-bezogenen Kompetenzen mit[11], in der Automobilbranche sind es aktuell 13 Prozent[12] – mehr als genug Potenzial für einen Einbezug in betriebliche KI-Projekte. Dass zudem eine hohe Bereitschaft zur Gestaltung von KI vorliegt, zeigen die oben besprochenen Zahlen.

Organisation und Mensch sind aber nur die eine Seite der Gestaltung. Sie dürfen und können echte Mitbestimmung nicht ersetzen. Obwohl KI in vielen Unternehmen noch nicht einmal angekommen ist, gibt es hier schon konkrete Antworten und eine ganze Reihe praxisorientierter Gestaltungshilfen[13], Steckbriefe[14], Checklisten[15] und Erklärfilme[16]. Diese können nicht nur Betriebsräte sowie betriebliche Datenschutz- und Arbeitsschutzbeauftragte unterstützen, sondern auch für Führungskräfte hilfreich sein – schließlich ist das Thema noch für alle Seiten relativ neu. Die hier diskutierten KI-bezogenen Gestaltungsherausforderungen lassen sich ohne Mensch und Organisation – und erst recht nicht ohne aktive Mitbestimmung lösen. Sie erfordern zudem eine neue Qualität der Technikgestaltung: Insbesondere, weil wir es mit sich autonom verändernder Technik zu tun haben, braucht es einen „mitbestimmten Algorithmus“, in den sich die gewünschten Gestaltungskriterien auch softwaretechnisch einbauen lassen.[17]